Pojawienie się nowych technologii zawsze budziło gorące dyskusje. Nie inaczej jest w przypadku sztucznej inteligencji. To co jednych zachwyca, u innych budzi skrajne obawy. Dyskusja wrze, a technologia AI zupełnie nie zrażona, tuż obok rozwija się w niespotykanym do tej pory tempie. Rzecz jasna nie patrząc na to czy ludzkość za nią nadąża.

Wiele z decyzji podejmowanych zostaje na podstawie intuicji. Chociaż to dopiero początek rewolucji AI, wszyscy łącznie z twórcami sztucznej inteligencji mamy duży problem z jej zrozumieniem.

Mamy także świadomość, że aby nasi użytkownicy korzystali z produktów AI (w tym z Intelligent User Interface), muszą być skłonni jej (AI) zaufać. Żeby to się stało, musimy zrobić wszystko, by mogli ją w pełni zrozumieć i czuć się w jej towarzystwie komfortowo oraz bezpiecznie.

Zrozumieć sztuczną inteligencję

Explainable AI podejmuje się wyjaśnienia końcowemu użytkownikowi, jak działa AI, a dokładnie w jaki sposób model podejmuje decyzje. W skrócie chodzi o to, aby odpowiedzieć na pytanie, co się dzieje w środku czarnej skrzynki (AI Black Box).

W ramach toczącej się debaty wyszczególnia się aktualnie kilka terminów niezbędnych do zrozumienia ludzkiego postrzegania procesów AI. Są nimi:

- Interpretowalność: sytuacja, w której działania modelu można opisać w zrozumiałych dla człowieka terminach.

- Wytłumaczalność: rozumiana jako interfejs między ludźmi a systemem, który czyni go dla nas zrozumiałym.

- Przejrzystość: występuje wtedy, gdy człowiek może zrozumieć funkcję modelu bez potrzeby wyjaśniania.

- Nieprzezroczysty: występujący jako przeciwieństwo przezroczystego modelu. Jego interpretacja, wymaga wyjaśnień.

- Zrozumiałość: Zdolność algorytmu uczenia się do reprezentowania swojej wyuczonej wiedzy w zrozumiały dla człowieka sposób.

Więcej o Explainable AI for UX przeczytasz tu.

Łatwo zauważyć, że każdy z tych terminów odnosi się do próby zrozumienia modelu i opisu jego działania.

Gdzie możemy szukać rozwiązania? Dyskusja dotyczy komunikacji z AI, więc powinniśmy skupić się na tworzeniu inteligentnych interfejsów człowiek-AI. W efekcie zbudować platformę zdolną do rozumienia działań sztucznej inteligencji i tym samym dać jej przestrzeń do wyrażania siebie – a nam możliwość trafnej interpretacji.

To oczywiście wyzwanie dla specjalistów AI, badaczy oraz projektantów interakcji. Problem w tym, że odbiorcami procesów są nie tylko matematycy czy specjaliści, ale całe społeczeństwa. Dzieci, dorośli, osoby mniej biegłe z technologią, osoby z niepełnosprawnościami.

Bardzo różnorodna grupa użytkowników z różnym doświadczeniem, preferencjami i oczekiwaniami. W tej sytuacji obok tajemniczej natury AI, to również złożoność natury ludzkiej zaczyna stanowić wyzwanie.

Codzienność z AI

Chociaż Generative AI osiągnęła w 2023 roku szczytowy punkt popularności, wciąż nie dysponujemy wystarczającą ilością badań, aby jasno określić jakimi heurystykami rządzi się interakcja człowieka z dużymi modelami językowymi (LLM).

Dowiedz się więcej o LLM z tego artykułu.

Jedno z niewielu badań w tym zakresie wykonał zespół Jacoba Nielsena badając użytkowników podczas korzystania z Chat GPT. Wyniki przedstawione przez NNGroup sugerują, że naszą główną techniką pracy z Gen AI jest tzw. „apple picking”. Schemat interakcji, w której rozpoczynamy dialog ze sztuczną inteligencją od ogólnego zapytania, a następnie, w zależności od adekwatności pierwszej odpowiedzi, dopytujemy zadając bardziej szczegółowe pytania.

Efektywność tego wzorca pozostawia wiele do życzenia, a skutek nie zawsze jest zadowalający. Dopytywanie wymaga czasu i po kolejnych niezadowalających próbach może rodzić niemałe frustracje. Co więcej, model czasami halucynuje lub nie udziela odpowiedzi ze względu na regulamin usługi.

Inny sposób uzyskania odpowiedzi od Chat GPT to stworzenie ustrukturyzowanego zapytania/„prompta” (prompt – forma jaką przyjmuje pytanie zadawane do modelu językowego). Przykładowa konstrukcja prompta w pierwszym korku definiuje role AI, w drugim określa kontekst w jaki zadajemy pytanie, w trzecim adresuje zapytania i na koniec określa oczekiwaną formę odpowiedzi.

Zachęcam sprawdzić o ile dokładniejszą odpowiedź otrzymamy posługując się drugim sposobem.

Oczywiście, praca z ChatGPT jest ekscytująca i przy pierwszym kontakcie można się zachłysnąć inteligencja modelu, jednak dla projektantów interakcji to za mało.

Kontekst zmienia wszystko

W procesie oceny interfejsu kluczowe są trzy zmienne:

- jakość doświadczeń użytkownika,

- zrozumiałość interakcji,

- efektywność interakcji.

Interakcja oparta na interfejsie ChatGPT w każdym z tych aspektów jest w większym bądź mniejszym stopniu niedoskonała. Tu warto sięgnąć do niecodziennych, a jednak dotyczących części użytkowników problemów. Wystarczy, że nie jesteśmy w stanie sprawnie pisać na klawiaturze i cała interakcja sypie się jak domek z kart.

Dowiedz się więcej o testowaniu AI 👉

Idąc dalej, zastanówmy się chwilę nad interakcją ze znanymi nam asystentami głosowymi. W najnowszych rozwiązaniach możemy pozwolić sobie na swobodną rozmowę wykorzystując naturalny interfejs, jakim jest nasz głos.

Wystarczy jednak, że zmieni się kontekst w jakim wchodzimy w interakcje i już napotykamy kolejne problemy. Chociażby miejsca publiczne w dużej mierze dyskwalifikują korzystanie z formy głosowej, a operowanie na danych poufnych jest w tym przypadku zdecydowanie niewskazane.

AI jako Gamechanger

Zespół New York University Dubai pracuje nad ciekawym projektem, którego celem jest wspieranie osób cierpiących na chorobę Alzheimera w codziennym funkcjonowaniu. Projekt ten nosi nazwę MemoryComapnion.

Z projektem MemoryCompanion zapoznasz się tutaj.

W dużym skrócie, badacze z New York University Dubai pracują nad rozwiązaniem, w którym Large Language Model (po odpowiednio skonstruowanym procesie uczenia) zostaje spersonalizowany względem potrzeb chorego i udziela mu podpowiedzi w konkretnych sytuacjach związanych z chorobą.

W trakcie pracy model coraz dokładniej poznaje użytkownika i w obrębie tworzonej hiperpersonalizacji staje się towarzyszem łagodzącym poczucie samotności i izolacji społecznej.

Wyzwanie, którego podjęli się twórcy, jest niezwykle złożone. Z jednej strony wymaga zrozumienia, jak funkcjonują osoby z demencją, jak wygląda przebieg choroby oraz jaką rolę odgrywają bliscy i opiekunowie. Z drugiej zbudowania rozwiązania wykorzystującego różne formy możliwej interakcji ze sztuczną inteligencją.

W tym przypadku niezwykle ważny jest kontekst etyczny współpracy AI z chorym oraz bezpieczeństwo wymienianych w czasie interakcji wrażliwych danych medycznych.

Czy potrafimy sobie wyobrazić, jak powinien wyglądać interfejs takiego produktu? Co sprawi, że chorzy będą wchodzili w interakcję z asystentem?

Czy AI powinna mówić głosem bliskiej osoby, przywoływać obrazy i analizować trasy jakimi porusza się chory? Czy interfejs powinien być taki sam dla chorego i dla jego opiekuna? To tylko kilka z wyzwań, które stoją przed twórcami MemoryCompanion.

Dziś już wiemy, że w podobnych sytuacjach użytkownik potrzebuje czegoś więcej niż zwykłego interfejsu GUI. Niezbędny jest Inteligentny Interfejs Użytkownika (IUI – Intelligent User Interface), który będzie w stanie dostosować optymalną formę interakcji do kontekstu.

Zobacz jak EDISONDA wspiera projektowanie interfejsów medycznych

Czym są Inteligentne interfejsy?

Termin Inteligentne Interfejsy Użytkownika (IUI) został stworzony do opisania integracji sztucznej inteligencji z podejściem User Centered Design (UCD). Tym samym IUI to taki typ interfejsu, który stara dostosować się do typu interakcji, kontekstu oraz do profilu zaangażowanego w interakcję użytkownika.

Można powiedzieć, że inteligentne interfejsy budowane są w celu wspierania realnej współpracy człowieka z AI. To w pewnym sensie interfejsy „świadome sytuacji”, w której są używane.

Jednym z najbardziej znanych inteligentnych interfejsów, który zrewolucjonizował sposób podróżowania samochodem jest… nawigacja.

Czy ktoś z nas wyobraża sobie podróż bez tej aplikacji? Co takiego powoduje, że włączamy ją odruchowo przy wsiadaniu do auta i większość z nas obsługuje ją bez problemu, choć nikt z nas nie jest mistrzem kartografii?

Za tą wysoką użyteczność oraz efektywność nawigacji samochodowej odpowiada intuicyjny inteligentny interfejs, który jest napędzany sztuczną inteligencją.

Zauważmy, że wykorzystuje on kombinacje różnych form interakcji w celu zapewnienia pełnego zrozumienie danychprzekazywanych nam przez AI.

- W aplikacji wykorzystujemy Graficzny Interfejs użytkownika (GUI) do prezentacji mapy i naszej pozycji,

- GUI wspierają animacje pozwalające zaprezentować zmienność danych w czasie rzeczywistym.

- Mapą możemy nawigować przy pomocy dotyku, komunikatów głosowych oraz

To właśnie połączenie tych trzech form interakcji w jednym interfejsie czyni doświadczenie komunikacji z AI zrozumiałym i użytecznym.

Opisanie danych, czasu, odległości czy wreszcie przestrzeni odpowiednimi parametrami pozwala całkowicie i dokładnie zrozumieć to co przekazuje nam AI.

Żeby zaprojektować tak doskonały interfejs potrzebna jest wiedza psychologiczna o ludzkiej uwadze, szereg wcześniejszych badań monitorujących zachowanie kierowcy podczas jazdy oraz testowanie prototypów z uwzględnieniem kontekstu jazdy i typu kierowcy. O każdej porze dnia i w przypadku różnych aut.

Dowiedz się jak EDISONDA badała nawigację 👉

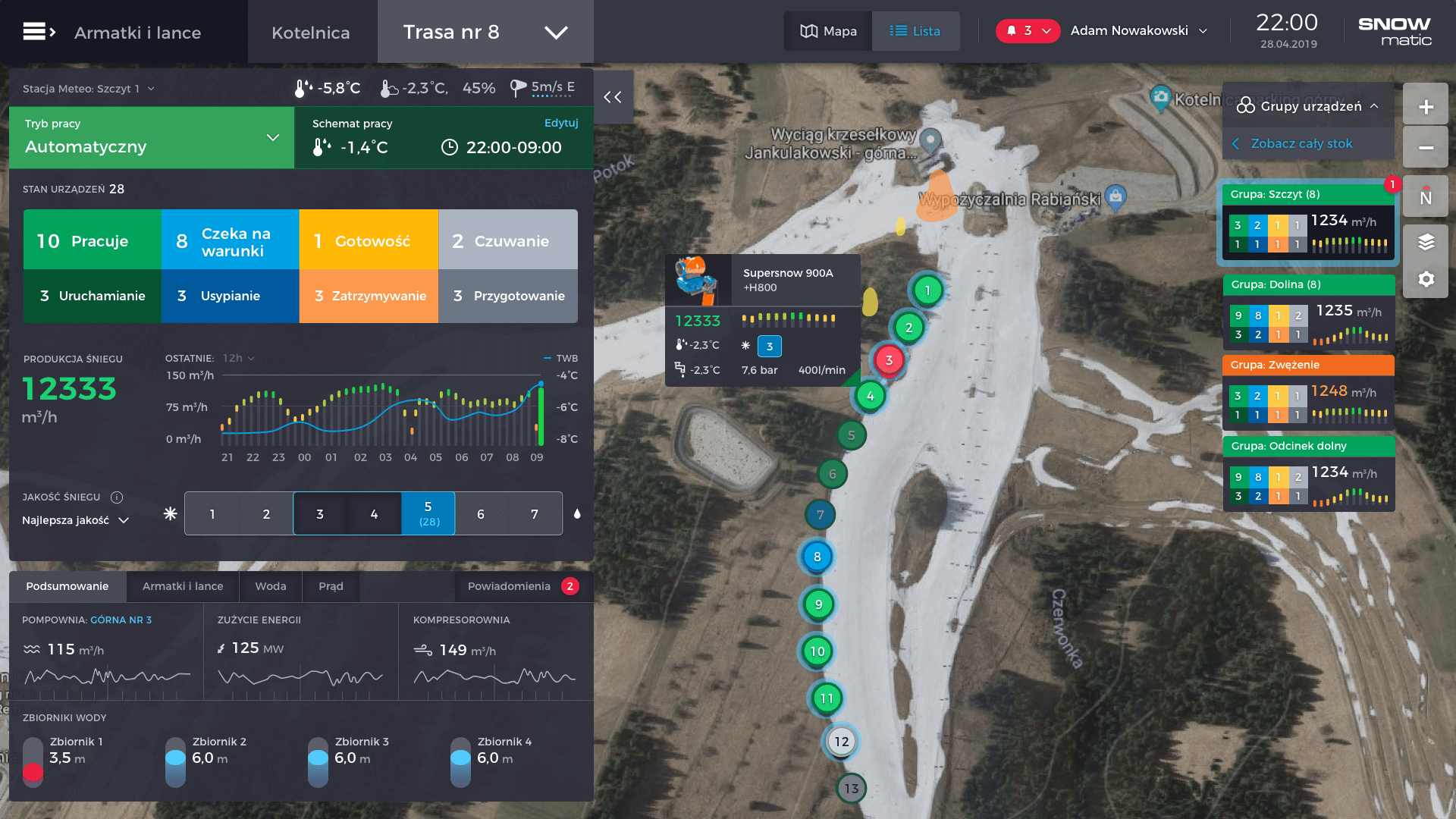

Innym przykładem IUI są wszelkiego rodzaju dashboardy monitorujące działania podejmowane przez działające w tle algorytmy AI.

Sprawdzają się one szczególnie tam, gdzie potrzebne jest szybkie podejmowanie decyzji lub monitorowanie przebiegu procesu przez całą dobę.

Świadomość możliwości

Inteligentne interfejsy świetnie wykorzystuje branża finansowa. W obszarze inwestycji od dawna reagowanie na zmiany na rynku oddawane jest algorytmom sztucznej inteligencji. Działa to najczęściej tak, że na bazie wiedzy o naszym poziomie akceptacji ryzyka oraz możliwościach finansowych algorytm AI balansuje nasz portfel inwestycyjny.

Inteligencja interfejsu polega tutaj na przekazywaniu danych w czasie rzeczywistym i dobierania form komunikacji w zależności od kontekstu. Interfejs dostarcza nam informacji na temat podejmowanych przez AI decyzji oraz daje możliwości natychmiastowego przejęcia kontroli nad procesem inwestycyjnym. Transparentność procesu budujeinformowanie klienta, na jakiej podstawie algorytm podejmuje decyzję, a także szybki dostęp do informacji na dashboardzie inwestycyjnym aplikacji.

Poznaj projekt Robota Inwestycyjnego dla ING, którego projekt wspierała Edisonda.

Interfejs działa kontekstowo i „rozumie sytuację” w tym sensie, że przy gwałtownych reakcjach rynku AI przy pomocy powiadomień aplikacji jest w stanie poinformować użytkownika na bieżąco o swoich działaniach. Może też prosić o potwierdzenie wykonania akcji kupna lub sprzedaży.

Nie mniejsze zastosowanie mają Inteligentne Interfejsy w specjalistycznych narzędziach. Tam kluczowa jest bezbłędna współpraca pomiędzy trybem automatycznym sterowanym przez algorytmy sztucznej inteligencji, a trybem ręcznym w którym człowiek podejmuje decyzje. Świetnym przykładem tego typu rozwiązania są specjalistyczne systemy kontrolujące naśnieżanie stoków narciarskich.

Wszyscy wiemy jak kapryśna bywa pogoda i jak potrafi pokrzyżować plany organizatorom zawodów narciarskich. Tu z pomocą przychodzą właśnie Inteligentne Interfejsy. W zależności od potrzeb, mogą one sterować całym procesem naśnieżania. Od kontroli wydajności maszyn, pracę armatek śnieżnych, przez dobór jakości śniegu do uwzględniania aktualnych warunków atmosferycznych. Odpowiednio zaprojektowany interfejs zapewnia użytkownikowi dostęp do informacji o pracy systemu w czasie rzeczywistym. Dodatkowo, zarządzanie systemem może odbywać się z dowolnego miejsca na świecie!

Przeczytaj więcej o systemie Snowmatic, który projektowała Edisonda.

To tylko niektóre przykłady już funkcjonujących wokół nas interfejsów, powstałych jeszcze przed tak zwaną erą Gen AI.

Teraz gdy sztuczna inteligencja wchodzi bezpardonowo do naszego życia, Inteligentne Interfejsy to wciąż nieuświadomiona potrzeba użytkownika!

Jeżeli chcemy w pełni świadomie i efektywnie korzystać z możliwości, jakie niesie ze sobą AI, musimy zacząć komunikować się z nią przez adekwatne sposoby. Interfejsy muszą być zrozumiałe, dostępne, a korzystanie nie powinno wymagać od użytkowników wcześniejszego szkolenia. Musimy tworzyć język komunikacji z AI odporny na wykluczenie cyfrowe.

Jak wygląda proces tworzenia inteligentnych interfejsów użytkownika?

Proces rozpoczyna się od dokładnego zrozumienia kontekstu, w którym funkcjonuje użytkownik oraz problemów, z jakim mierzy się w danej sytuacji. Bardzo istotne jest poznanie kontekstu, ponieważ to ono wyznacza jaki rodzaj sztucznej inteligencji wybierzemy i do czego zostanie wykorzystana w produkcie.

Po jaki rodzaj AI sięgniemy, tworząc nawigację samochodową? Czy LLM będzie ją wspierał tak samo dobrze jak przeglądarkę dla osób niewidomych?

Decydując się na stworzenie produktu wspieranego sztuczną inteligencją, koniecznie uzbrójmy się w cierpliwość i przeprowadźmy dokładne rozeznanie. W kontakcie z AI jest wiele aspektów, które bez dokładnej fazy Discovery najpewniej nie zostaną wykryte. Wtedy na pewno zaskoczą nas w dalszej fazie tworzenia inteligentnego produktu.

To kontekst i typ zadania determinują, czy skorzystamy z interfejsu głosowego, tekstowego, konwersji mowy na tekst czy rozpoznawania twarzy. W pracy ze sztuczną inteligencją wcześniejsze założenia muszą zostać potwierdzone, zanim przystąpimy do działania.

Nigdy nie powinniśmy działać odwrotnie, czyli próbować dopasowywać sytuację do technologii. Może to prowadzić do szeregu problemów i niepotrzebnych wydatków.

Dowiedz się więcej o badaniu AI Discovery 👉

Kolejny krok to wybór technologii. Zakresu jej użycia oraz wyceny złożoności i czasochłonności prototypu (POC). Decyzje te podejmujemy na podstawie twardych wniosków z fazy Discovery i dokładnie zmapowanej ścieżki użytkownika (Customer Journey AI).

Musimy mieć świadomość, że na tym etapie rozwoju AI wciąż jesteśmy pionierami w pracy ze sztuczną inteligencją.

Większości przypadków, których podejmują się zespoły projektowe, jest budowana po raz pierwszy, a przykładów zastosowania technologii do konkretnego przypadku jest niewiele.

Dlatego prototyp w projektach wykorzystujących sztuczną inteligencję jest krokiem koniecznym. Etap POC pozwala przy relatywnie niewysokich kosztach sprawdzić, w jakim stopniu wybrana technologia będzie w rzeczywistości wspierać wykonanie zadania

Następnym ważnym elementem jest projekt interfejsu użytkownika.

W zależności od typu rozwiązywanego problemu może on być nawet prostym ekranem z powiadomieniami. Jednak przy złożonych produktach, które mogą być używane w różnych kontekstach, to właśnie interfejs będzie miał krytyczny wpływ na sposób korzystania z produktu i efektywność pracy z modelem. To on będzie odpowiedzialny za komunikację pomiędzy użytkownikiem a budowanym na bazie modelu rozwiązaniem.

Zarówno prototyp modelu jak i interfejs w fazie POC powinien zostać poddany testom z użytkownikami. Tylko w takimpodejściu AI jest w stanie zaadaptować się odpowiednio do kontekstu użycia i spersonalizować względem potrzeb użytkowników.

Wracając do przykładu asystenta dla osób z demencją, w trakcie testów prototypu z użytkownikami możemy odkryć, że same podpowiedzi tekstowe lub głosowe nie są wystarczające, ponieważ użytkownik nie potrafi sobie przypomnieć wyglądu osoby.

Wiedza zdobyta dzięki testom pozwoli na rozbudowę inteligencji modelu, a co za tym idzie również lepsze dopasowanie interfejsu.

Zapoznaj się z naszym raportem – Rocket Ideas: Healthcare

Przyszłość jest zapisana w interakcji

Proces tworzenia produktów wspieranych sztuczną inteligencją to fascynująca i niezwykle kreatywna droga. Im więcej wiemy o naszych użytkownikach, ich problemach i samej technologii, tym prościej jest nam podejmować właściwe decyzje. Czym więcej testujemy, tym interfejsy naszych produktów są bardziej zrozumiałe, a działanie AI nie wymaga interpretacji.

W najbliższych latach będziemy świadkami skokowego rozwoju inteligentnych interfejsów użytkownika wspieranych sztuczną inteligencją. W przeciągu 5 lat interfejsy, które znamy, odejdą w niepamięć, a ich miejsce zajmą interfejsy przyszłości dostosowujące się do kontekstu użycia i zapytań.

Efektywność codziennych zadań i obecnie złożonych procesów znacznie się uprości, a człowiek odzyska czas na samorozwój i odpoczynek. Zanim to się jednak stanie twórcy inteligentnych produktów powinni jak najszybciej zacząć współpracować z projektantami i badaczami interakcji człowiek-AI.

Natomiast sponsorzy biznesowi projektów muszą mieć na uwadze, że inwestując czasami olbrzymie pieniądze, liczą się z tym, że produkt niedostosowany do relacji człowieka z AI i może nie spełnić oczekiwań odbiorców i pogrzebać cele biznesowe.

Tworząc nową kategorię inteligentnych produktów cyfrowych, pamiętajmy, że to na nas ciąży odpowiedzialność uczynienia tych produktów zrozumiałymi, bezpiecznymi i dostępnymi.

Dlatego współpracujmy, eksperymentujmy i dzielmy się wiedzą z badań AI. Po to, aby ograniczyć ryzyko niepowodzenia i tworzyć produkty nie tylko użyteczne, ale także dając satysfakcję z korzystania i zapewniające równość użytkowników.